軟件所等在像素級高效人手檢測研究中取得進展

文章來源:智能軟件研究中心 | 發布時間:2019-03-25 | 【打印】 【關閉】

近日,中國科學院軟件研究所武延軍團隊在像素級高效人手檢測領域取得新進展,為人手運動視頻的實時檢測估計處理提供了一種新方法,有望用于網約車、公交車等駕駛狀態實時監控,減少安全事故。相關成果以Scale Invariant Fully Convolutional Network: Detecting Hands Efficiently為題發表于國際人工智能會議AAAI Conference on Artificial Intelligence (AAAI 2019),論文通訊作者為軟件所助理研究員張立波。

傳統人手檢測方法利用人工特征提取與分類器結合,特征具有局限性,提取時間開銷大,而基于深度學習的方法對尺度較小的首部區域漏檢概率大,同時網絡結構復雜,訓練和測試時間長,不能達到實時檢測的要求。

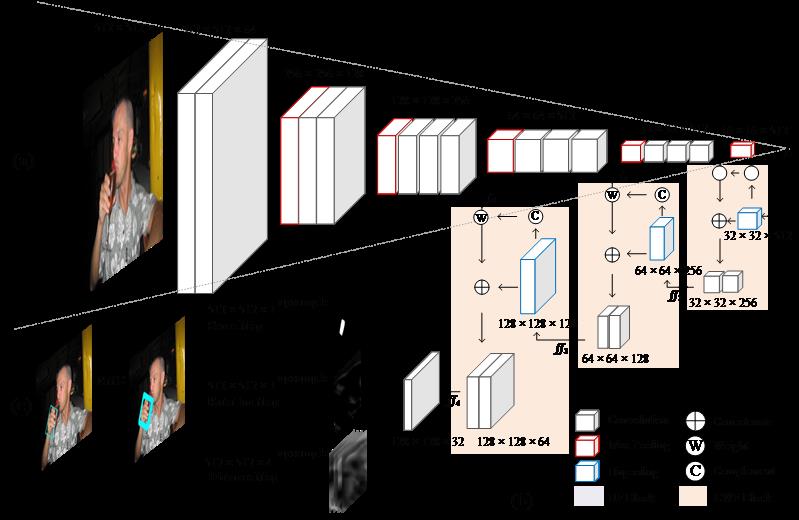

以上問題導致現有算法無法同時滿足具體場景中準確率和實時性的要求,嚴重制約了人手檢測在實時視頻處理中的應用。軟件所武延軍團隊提出了一種尺度不變的全卷積神經網絡,補充加權特征融合模塊學習不同尺度的特異性,對網絡的中間層也加入了監督,以迭代的方式融合多個尺度的特征進行最后的預測,與當前最好方法相比,在保證精度的同時檢測速度更快,將單張圖像處理速度最高提升4.23倍,首次達到62.5 fps。

該研究為智能視頻中的人手處理奠定了基礎,在公交車/網約車安全監控、智能交通和無人駕駛等領域具有廣泛應用前景。該研究工作目前得到國家自然科學基金的支持。

圖1. 研究提出的網絡結構: (a) 特征提取部分, (b) 特征融合部分, (c) 輸出部分.

圖2. 結果對比,SIFCN (青色,該研究) 和 Multi-scale fast RCNN (紅色,Yan et al. 2017): (a) VIVA 數據集 (b) Oxford 數據集.