軟件所人機交互團隊研究工作取得進展

文章來源: | 發布時間:2021-01-22 | 【打印】 【關閉】

ACM CHI (ACM CHI Conference on Human Factors in Computing Systems)是人機交互領域頂級國際學術會議(CCF-A)。ACM CHI 2021將于5月8號到13號舉行線上會議(原定于日本橫濱),大會共收到論文投稿2844篇,最終錄用率約為26.3 %。中國科學院軟件研究所田豐研究員帶領的人機交互團隊,在自然人機交互基礎理論與交互技術等方面與國內外合作者共同開展了多項研究工作,共有5篇長文被接收。以下就該5項成果進行簡單介紹。

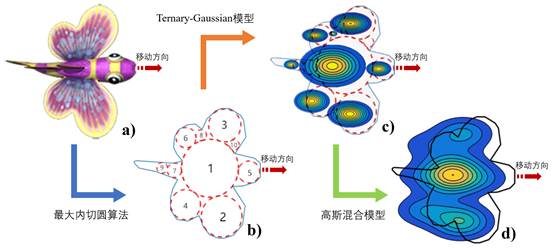

1.Modeling Pointing Uncertainty for Moving Targets with Arbitrary Shapes

移動目標獲取任務在自然用戶界面中廣泛存在,該團隊在國際上率先開展了針對移動目標選擇落點不確定性的研究工作。2018年,團隊開創性地提出了一維Ternary-Gaussian移動目標獲取不確定性模型,并在隨后的兩年期間,將該模型拓展到二維移動目標和基于“穿越”的目標選擇任務當中。本次被ACM CHI 2021接收的工作則進一步實現了Ternary-Gaussian模型對任意形狀移動目標的建模,極大地拓寬了該模型和其衍生技術在用戶界面中的適用性。

以往的移動目標選擇落點不確定性模型,通常使用二維高斯分布對規則形狀(例如圓形或矩形)的目標選擇落點分布進行描述,然而當目標形狀任意時,受到運動視覺和錯誤懲罰的影響,用戶的擇落點呈現出多峰分布而非標準高斯分布。為了解決這一問題,本項研究工作將高斯混合模型(Gaussian mixture model,GMM)與Ternary-Gaussian模型融合,更好地描述目標的形狀和運動兩部分因素對落點產生的影響。該模型首先利用最大內切圓算法將任意形狀目標劃分為不同大小但具有規則形狀的基本幾何體,然后利用Ternary-Gaussian模型給出這些基本幾何體的落點分布,最后通過GMM實現各基本幾何體落點分布的融合。GMM中各基本幾何體的權重由一個考慮多方面人類運動視覺因素的線性函數給出。結果表明,相對于之前的Ternary-Gaussian模型,本文模型能夠對任意形狀的移動目標選擇落點分布和目標選擇錯誤率做出更精準的預測。基于本項工作,研究人員給出了一系列針對動態用戶界面設計的指導原則。

任意形狀移動目標選擇落點不確定性的建模過程

論文作者:張子悅(中科院軟件所),黃進(中科院軟件所,通訊作者),涂華偉(La Trobe University),田豐(中科院軟件所)。

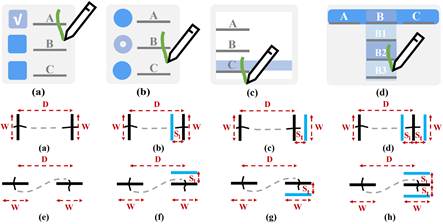

2.Distractor Effects on Crossing-Based Interaction

在目標選擇任務中,任務無關的干擾目標對人類視覺運動控制的影響已成為人機交互領域的研究熱點。然而,對于基于“穿越”的目標選擇這一普遍使用的交互范式,關于干擾目標對其用戶表現影響的研究卻很少。

為了研究干擾目標對穿越目標選擇用戶表現的影響,本項工作對四個包含干擾目標和兩個不包含干擾目標的穿越目標選擇任務進行了對比分析。這六個任務在運動精度約束(方向/幅度)、目標大小、目標距離、干擾目標位置和目標與干擾目標間距上存在差異。研究人員還為這六個任務開發了六個定量模型并進行了實驗驗證。結果表明,與不包含干擾目標的穿越目標選擇任務相比,包含干擾目標的任務平均時間更長,而準確度相近。干擾目標的作用隨干擾目標位置、目標與干擾目標間距和運動精度約束的不同而發生變化。當間距足夠小時,包含干擾目標的穿越目標選擇任務可以被視為指點任務或指點與穿越任務的組合,與Fitts定律相比,本項工作提出的模型取得了更高的擬合精度。根據本項工作獲得的結果,研究人員為基于“穿越”的用戶界面設計提供了切實可行的設計指導。

基于“穿越”的目標選擇任務和實驗范式

論文作者:涂華偉(La Trobe University),黃進(中科院軟件所,通訊作者),Hai-Ning Liang(西交利物浦大學),Richard Skarbez(La Trobe University),田豐(中科院軟件所),Henry Been-Lirn Duh(La Trobe University)。

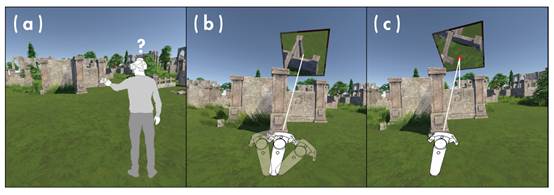

3.vMirror: Enhancing the Interaction with Occluded or Distant Objects in VR with Virtual Mirrors

由于虛擬現實(VR)中物體之間互相遮擋,用戶尋找并選擇被遮擋的目標物體變的十分困難。盡管用戶可以通過遠程傳送(teleport)等方式調整他們的位置和方向,以幫助觀察和選擇,但反復移動和視角轉換會造成方向感的迷失以及暈動癥等不適。

在本項工作中,研究人員設計了一個VR下的交互部件vMirror,利用鏡子的反射來觀察和選擇遠距離被遮擋的物體。首先通過兩項實驗,分別探索了半自動放置鏡子方法與手動放置方法的對比、鏡面方向對用戶目標選擇任務表現的影響,結果表明大多數鏡面方向上,vMirror與直接選擇目標的效率接近。最后在一個VR尋寶游戲中對比了teleport與teleport+vMirror技術,并測量參與者的任務表現和主觀體驗。結果表明,使用teleport+vMirror技術搜尋目標的效率更高,并且有效減少用戶的眩暈。

用戶通過創建“鏡子”對被遮擋目標進行選擇

論文作者:李念龍(中科院軟件所),張政權(西安交通大學),劉燦(香港城市大學),楊增耀(西安交通大學,通訊作者),付軼楠(廈門大學),田豐(中科院軟件所),韓騰(中科院軟件所),范明明(Rochester Institute of Technology)。

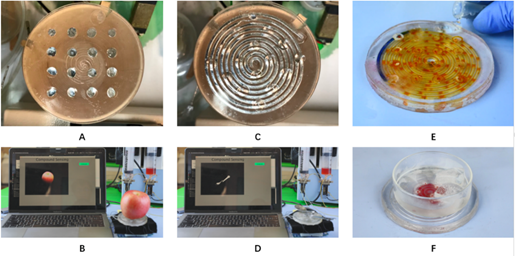

4.RElectrode: A Reconfigurable Electrode For Compound Sensing Based on Microfluidics

環境感知是交互領域的一項重要技術,但在當下環境中,物體的組成物質越來越復雜、特性差異越來越大,而且傳統傳感器功能單一、傳感器之間也存在相互干擾問題。

在本項工作中,研究人員提出了一種基于微流控技術的電極重構與變換的方案,具有物體檢測功能,具體包含一些電器特性、物理特性、化學特性的檢測,并整合了手勢操控(觸摸/非觸摸)、按鍵操控等交互功能。實驗結果顯示,基于這個電極,研究人員能夠實現12種物體,10種手勢,16個按鍵、溫度、pH的檢測。展示了一種制造具有可重構功能的電子傳感器的可行方法。

通過可變電極進行物體識別、溫度檢測和pH檢測

論文作者:孫偉(中科院軟件所),陳彥君(中科院軟件所),詹思農(University of California,Berkeley),韓騰(中科院軟件所,通訊作者),田豐(中科院軟件所),王宏安(中科院軟件所),Xing-Dong Yang(Dartmouth College)。

5.Towards a Truly "Brilliant" AI-Powered Clinical Decision Support System: Lessons from a Study of Rural Clinics in China

人工智能(AI)技術已越來越多地應用于高級臨床決策支持系統(CDSS)的實踐中。研究證明了人工智能驅動的CDSS(AI-CDSS)在臨床決策場景中的潛在有效性。然而,采用后的用戶感知和體驗仍然沒有得到充分的研究,特別是在發展中國家。

該項工作通過對來自中國6個農村診所的22名臨床醫生的觀察和訪談,報告了AI-CDSS系統設計與農村臨床環境之間的幾種不足,如與當地環境和工作流程的不一致、技術限制和可用性障礙等,以及與AI-CDS的透明度和可信度相關的問題。盡管存在這些不足,所有參與者都對AI-CDSS的未來表達了積極的態度,尤其是能夠充當“醫生的智能助手”。該項工作還探討了為發展中國家的農村臨床環境設計AI-CDSS干預措施的意義。

調研AI-CDSS系統設計與農村臨床環境的現場照片

論文作者:王大闊(IBM Research),汪柳萍(中科院軟件所,共同一作),Zhan Zhang(Pace University),Ding Wang(Microsoft Research India),Haiyi Zhu(Carnegie Mellon University),Yvonne Gao(The State University of New York at Stony Brook),范向民(中科院軟件所),田豐(中科院軟件所,通訊作者)。