軟件所在圖表示學習因果性提升方面取得進展

文章來源: | 發布時間:2023-02-09 | 【打印】 【關閉】

近日,軟件所天基綜合信息系統重點實驗室研究團隊在圖表示學習方法研究中取得進展。成果論文“Robust Causal Graph Representation Learning against Confounding Effects”被人工智能領域頂級學術會議AAAI(Association for the Advancement of Artificial Intelligence)接收并作為oral報告,共同第一作者為博士生高航、李江夢。論文首次提出一種新的圖表示學習方法:魯棒因果圖表示學習(RCGRL)。該方法通過引入工具變量來消除圖表示學習中的混雜因子,實現了圖表示學習因果性的有效提升。

圖表示學習旨在學習復雜圖結構數據的特征表示,相比于圖像或序列化數據的表示學習,圖表示學習應用場景中的數據更加不規則,語義信息更加豐富,且常常會存在大量與任務無關的混雜因子,對任務進行干擾。如何去除這些混雜因子,只保留與任務相關的因果信息,是研究團隊希望解決的問題。由于工具變量方法在一些經典領域對于噪聲信息的消除取得了較好的效果,因此研究團隊將該方法引入圖表示學習領域,以消除圖數據中的混雜因子對表示學習任務的影響。

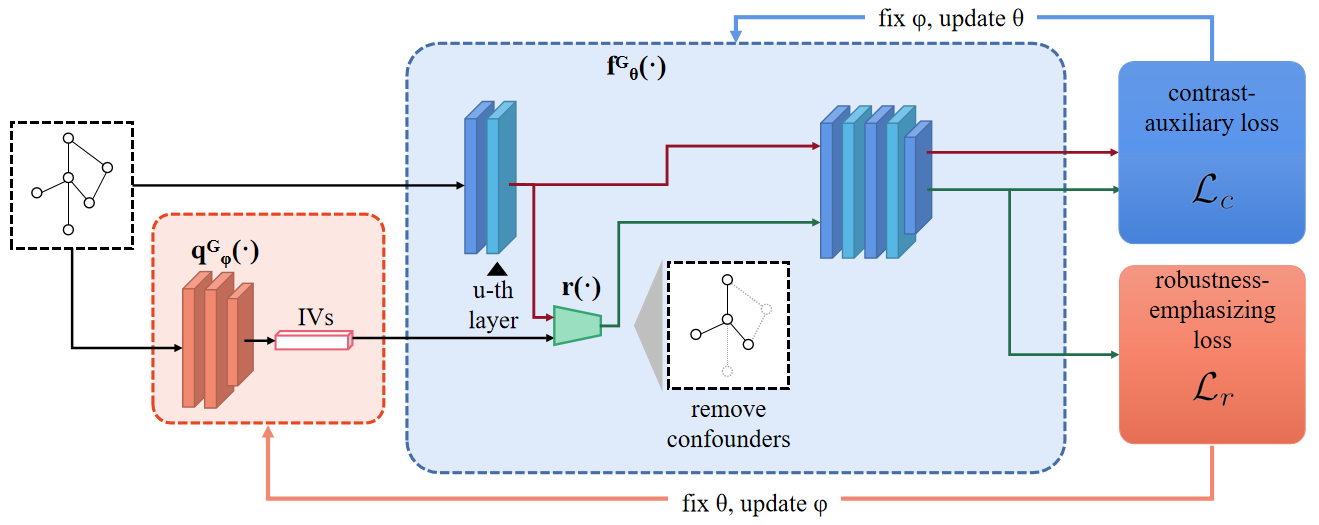

基于上述探索和分析,研究團隊遵循統計因果學的規律,提出了先基于神經網絡自主生成的工具變量進行混雜因子消除,然后使用處理過的因果數據對模型進行訓練,進而提升模型因果性的方法。團隊還通過特定的損失函數對生成工具變量的神經網絡以及進行表示學習的神經網絡進行交替訓練。訓練后的模型能夠細粒度的消除混雜因子對圖表示提取的影響,并最大限度的保留因果信息。

研究團隊基于涵蓋ID和OOD任務的六個不同的圖數據集建立多種下游任務基準及評估協議,將RCGRL方法與幾種廣泛使用的因果增強圖表示學習方法相對比,實驗結果表明RCGRL更具有優越性,在多種圖表示學習任務精度上明顯優于其它方法,有效提升了圖表示學習的因果性。

RCGRL方法框架